Claude vient de te donner une réponse parfaite. La syntaxe est impeccable. La logique est claire. La fonction qu'il propose a exactement le bon nom. Il t'a même donné le lien vers la documentation.

Il y a juste un problème : cette fonction n'existe pas. Le lien mène vers une erreur 404. Et tu viens de passer 2 heures à debugger du code basé sur quelque chose d'imaginaire.

Bienvenue dans le monde des hallucinations IA.

C'est Quoi Exactement Une Hallucination ?

Une hallucination, c'est quand Claude (ou n'importe quelle IA) invente quelque chose avec une assurance totale. Il ne "ment" pas intentionnellement. Il génère du texte qui a l'air vrai, qui est cohérent, qui semble parfaitement logique... mais qui ne correspond à aucune réalité.

Pourquoi ça arrive ?

Pour comprendre, il faut savoir comment fonctionnent les LLM (Large Language Models, les "grands modèles de langage" comme Claude ou GPT). Ils sont entraînés à prédire le texte le plus probable suite à une question.

Quand tu demandes "quelle fonction permet de faire X en JavaScript ?", Claude cherche dans ses connaissances le type de réponse qui serait statistiquement le plus approprié. Parfois, il trouve une vraie fonction. Parfois, il génère quelque chose qui ressemble à une vraie fonction mais qui n'existe pas.

C'est comme un étudiant qui, face à une question qu'il ne connaît pas, préfère inventer une réponse plausible plutôt que dire "je ne sais pas". Sauf que Claude le fait avec une confiance absolue.

Les Signaux d'Alerte À Connaître

J'ai appris à repérer les hallucinations à force de me faire avoir. Voici les signaux qui doivent te mettre la puce à l'oreille.

Signal 1 : Les détails trop précis sur des sujets obscurs

Quand Claude te donne un nom de fonction très spécifique, une librairie que tu ne connais pas, ou une option de commande précise, sois vigilant.

"Utilise la fonction

parseJSONSafe()de la librairiejson-toolkit-pro"

Le nom est parfait. parseJSONSafe semble logique. json-toolkit-pro sonne comme un vrai package npm. Mais si tu n'as jamais entendu parler de cette librairie, il y a de bonnes chances qu'elle n'existe pas.

Signal 2 : Les informations sur des événements récents

Claude a une date de coupure pour ses connaissances (knowledge cutoff). Il ne connaît pas les événements très récents. S'il te parle de "la mise à jour de décembre 2025" avec des détails précis, il invente probablement.

Signal 3 : Les réponses trop parfaites

Si la solution semble magique et résout tous tes problèmes en une ligne, c'est suspect. Le développement est rarement aussi simple.

"Il suffit d'utiliser

autoFixEverything()et tous tes bugs seront résolus"

Ça n'existe pas. Et si ça existait, tout le monde l'utiliserait.

Signal 4 : Les URLs et liens

Claude génère des URLs qui semblent valides mais qui sont souvent inventées. Un lien vers https://docs.example.com/api/v2/specific-function peut être une pure invention.

Signal 5 : Les citations et références

Si Claude cite un article académique, un livre, ou un expert avec des détails précis (nom, date, page), vérifie. Ces citations sont souvent partiellement ou totalement inventées.

Comment Vérifier Ce Que Claude Dit

Voici mes techniques pour éviter de perdre des heures sur des hallucinations.

Technique 1 : Demande les sources

Tu viens de mentionner la fonction parseJSONSafe() de json-toolkit-pro. Donne-moi le lien vers la page npm de cette librairie et vers la documentation de cette fonction spécifique.

Si Claude hésite, change sa réponse, ou admet ne pas être sûr, c'est probablement une hallucination.

Technique 2 : Vérifie sur npm/PyPI

Pour toute librairie suggérée, fais une recherche rapide :

Une vraie librairie populaire a :

- Une page officielle

- Des téléchargements récents

- Un repository GitHub actif

- Des questions Stack Overflow

Si tu ne trouves rien, ça n'existe pas.

Technique 3 : Teste le code immédiatement

Avant d'intégrer du code suggéré par Claude dans ton projet :

- Crée un petit fichier de test isolé

- Essaie d'importer la librairie ou d'utiliser la fonction

- Exécute

Si tu as une erreur "module not found" ou "function is not defined", tu as évité une hallucination.

Technique 4 : Consulte la documentation officielle

Quand Claude mentionne une fonctionnalité d'un outil connu (React, Node, Python...), va vérifier dans la doc officielle :

- React

- MDN Web Docs pour JavaScript

- Python Docs

- Node.js Docs

Technique 5 : Reformule et confronte

Tu m'as suggéré d'utiliser json-toolkit-pro, mais je ne trouve rien sur npm. Cette librairie existe-t-elle vraiment ? Sinon, quelle alternative réelle me recommandes-tu ?

Claude peut souvent se corriger quand tu le confrontes. Il admettra parfois qu'il s'est trompé et proposera une vraie solution.

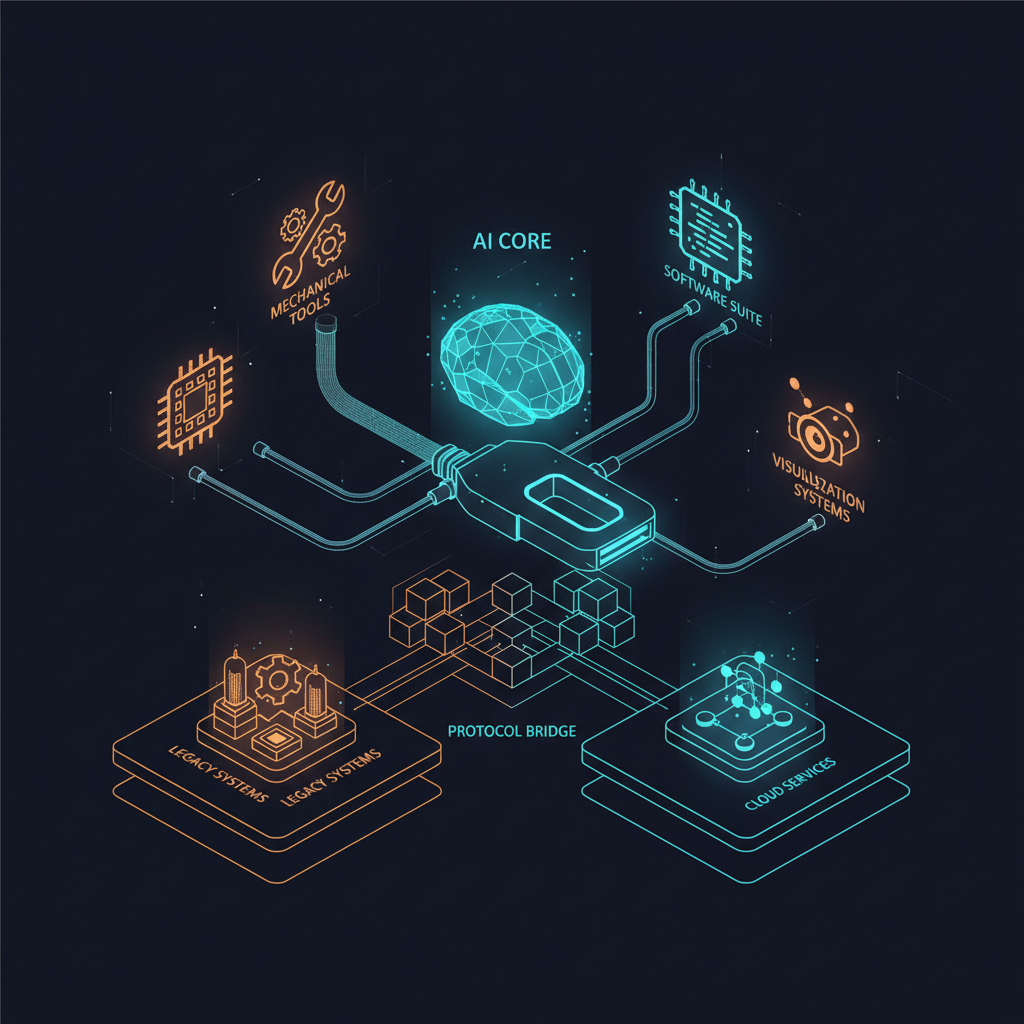

Les Domaines À Risque

Claude n'hallucine pas de façon uniforme. Certains domaines sont plus risqués que d'autres.

| Domaine | Niveau de risque | Pourquoi |

|---|---|---|

| Nouvelles librairies | Très élevé | Pas dans ses données d'entraînement |

| Commandes CLI obscures | Très élevé | Options faciles à inventer |

| URLs et liens | Très élevé | Peut générer des URLs plausibles mais fausses |

| API spécifiques | Élevé | Peut mélanger différentes versions |

| Fonctions de librairies | Moyen | Peut confondre avec des fonctions similaires |

| Concepts généraux | Faible | Bien documenté dans ses données |

| Syntaxe de base | Très faible | Maîtrisée par le modèle |

Mon Histoire : 2 Heures Perdues

Je te raconte ma pire expérience d'hallucination.

Je travaillais sur un script de migration de données. J'ai demandé à Claude comment faire une opération spécifique avec la CLI d'un outil (je ne me souviens plus lequel).

Claude m'a suggéré d'utiliser l'option --recursive-deep. Le nom semblait parfaitement logique. La commande complète avait l'air correcte. Je n'ai pas vérifié.

J'ai passé 2 heures à essayer de comprendre pourquoi ça ne marchait pas. J'ai cherché des bugs dans mon script, dans mes données, dans ma configuration...

Finalement, j'ai regardé la documentation officielle. L'option --recursive-deep n'existe pas. Claude l'avait inventée.

La vraie option était --recursive tout court. Deux heures de perdues parce que j'ai fait confiance aveuglément.

Depuis ce jour, je teste systématiquement toute commande avant de l'intégrer dans un workflow.

Les Hallucinations Classiques Que Je Vois Souvent

Voici les types d'hallucinations les plus fréquentes dans mon expérience.

1. Les fonctions qui n'existent pas

Claude peut inventer des fonctions avec des noms parfaitement logiques :

array.unique()(n'existe pas en JavaScript natif)string.reverse()(n'existe pas en JavaScript natif)object.deepClone()(n'existe pas nativement)

Ces fonctions devraient exister. Elles auraient du sens. Mais elles n'existent pas.

2. Les options de commandes inventées

Les commandes CLI ont beaucoup d'options. Claude peut en inventer qui semblent logiques :

npm install --save-exact-peer(n'existe pas)git commit --auto-fix(n'existe pas)docker run --auto-restart(n'existe pas, c'est--restart)

3. Les packages plausibles mais fictifs

Claude adore inventer des noms de packages qui sonnent bien :

react-super-hooksnode-easy-authquick-data-validator

Certains de ces noms pourraient exister (quelqu'un les a peut-être créés depuis), mais Claude les génère souvent sans vérifier.

4. Les syntaxes de versions futures

Claude peut utiliser des syntaxes qui seront peut-être ajoutées dans de futures versions mais qui n'existent pas encore :

// Claude peut suggérer

const result = await Promise.allSettled(promises).unwrap();

// Mais .unwrap() n'existe pas sur Promise.allSettledLa Bonne Nouvelle

Claude s'améliore continuellement. Et surtout, il est honnête quand tu le confrontes.

Tu es absolument sûr que cette fonction existe ? Je veux que tu me dises honnêtement si tu as le moindre doute.

Souvent, Claude répondra quelque chose comme :

"En fait, je ne suis pas certain à 100%. Il serait prudent de vérifier dans la documentation officielle. Voici une alternative dont je suis plus sûr..."

Il ne ment pas intentionnellement. Il génère du texte probable. Quand tu lui demandes d'être honnête sur son incertitude, il peut l'exprimer.

Ma Checklist Anti-Hallucination

Voici les réflexes que j'ai développés :

Pour les librairies et packages

- [ ] Chercher sur npm/PyPI

- [ ] Vérifier le nombre de téléchargements

- [ ] Regarder la date de dernière mise à jour

- [ ] Vérifier qu'il y a un repo GitHub actif

Pour les fonctions et méthodes

- [ ] Tester dans un fichier isolé

- [ ] Vérifier dans la doc officielle

- [ ] Chercher sur Stack Overflow

Pour les commandes CLI

- [ ] Lancer la commande avec

--helpd'abord - [ ] Tester sur des données non critiques

- [ ] Vérifier la documentation officielle

Pour les URLs et liens

- [ ] Cliquer avant de faire confiance

- [ ] Si 404, chercher la vraie page

La Règle des 3V

J'ai créé un acronyme pour m'en souvenir :

- Vérifie les noms (librairies, fonctions, commandes)

- Valide en testant le code

- Vérifie les sources (npm, doc officielle)

Ne fais jamais confiance aveuglément. Même à une IA très convaincante. Surtout à une IA très convaincante.

Pour Aller Plus Loin

Claude est un outil puissant, pas une source de vérité absolue.

Les hallucinations sont un phénomène inhérent aux LLM. Elles vont probablement diminuer avec le temps, mais elles ne disparaîtront jamais complètement. La vigilance est ton meilleur outil.

Le bon réflexe, c'est de traiter Claude comme un collègue junior très enthousiaste. Il a plein de bonnes idées, il travaille vite, mais tu dois relire son travail avant de le valider.

Pour ceux qui veulent aller plus loin : on a créé le Workshop "Bâtir avec l'IA".

Articles connexes pour devenir un utilisateur averti :

- La commande /fix est magique (mais dangereuse) : autre piège courant avec Claude

- Le fichier .claudeignore : ne donnez pas vos mots de passe : protège tes données sensibles

- Git pour les nuls : sauvegarder votre travail : ton filet de sécurité quand Claude se trompe

Utilise Claude. Mais vérifie.

— Charles